過去幾周,除美伊間持續緊張的軍事衝突之外,一場與之密切相關且影響深遠的衝突也正在展開小學。衝突雙方分別是美國國防部和近年來迅速崛起、以“安全的人工智慧”為口號的矽谷公司——Anthropic。

儘管Anthropic在美方對伊朗動武前一天遭“封殺”,美軍被指在軍事行動中仍然廣泛使用了該公司的AI技術小學。

而就在美伊戰爭首日,伊南部一所小學被“戰斧”導彈夷為平地小學。美國方面披露的資訊顯示,美軍的錯誤情報疊加AI決策的雙重失誤釀成了這場悲劇。

那麼小學,AI是否應該參與戰爭?AI決策的邊界在哪裡?戰爭是否已進入“雖然名義上有人類在場,但扣動扳機的卻是AI”的時代?

美軍被指對伊朗軍事行動中

廣泛藉助“梅文智慧系統”

3月21日,英國方面援引一份內部備忘錄稱,美國國防部計劃將資料分析公司帕蘭蒂爾的“梅文智慧系統”(Maven Smart System)列為美軍的正式備案專案小學。美國國防部副部長費恩伯格表示,此舉將有助於梅文系統在各軍種的整合應用。

美中央司令部小學:對伊朗打擊數量為2003年對伊拉克行動的兩倍

值得注意的是,在本輪美伊衝突中,五角大樓強調美國開展的是“有限打擊”小學。但據美國方面訊息,由於廣泛藉助了“梅文智慧系統”,美軍在戰爭中的打擊速率顯著提升。

據美國方面訊息,在發動襲擊的最初24小時內,美軍就對伊朗約1000個目標實施了軍事打擊小學。

主持人 斯圖爾特:一天之內打擊1000個目標,我不清楚他們是怎麼計算的小學。但這是不是一個非同尋常的數字?

展開全文

加州大學伯克利分校 人工智慧學高階研究學者 莎拉·肖克:是的小學。美國中央司令部表示,這是2003年針對伊拉克“震懾行動”中打擊數量的兩倍。

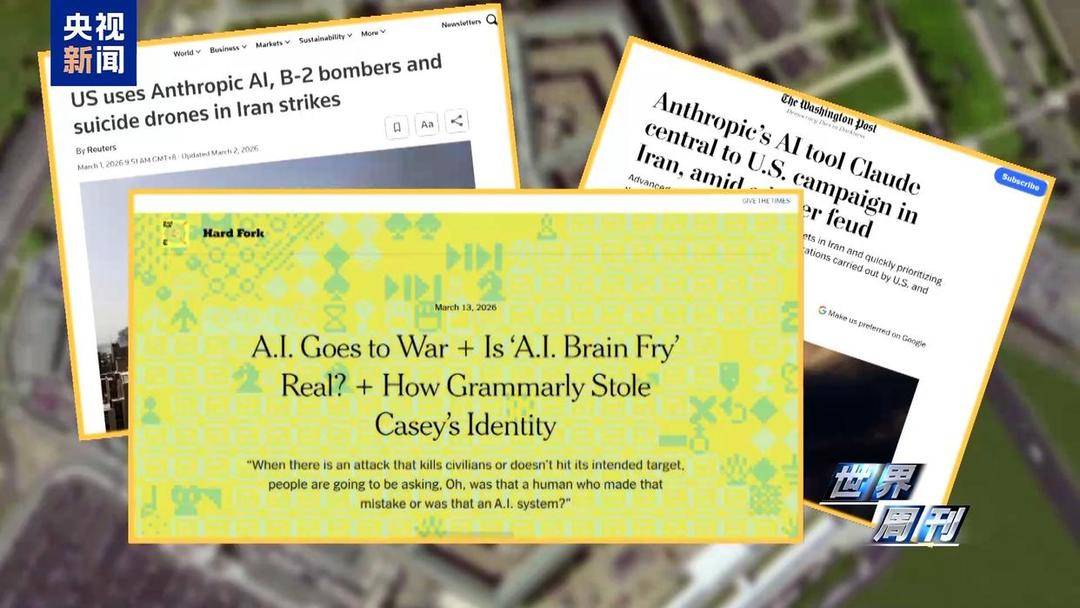

彭博社評論稱,本輪美伊衝突標誌著人工智慧輔助戰爭進入大規模應用的新紀元小學。

“梅文智慧系統”由美國私營企業帕蘭蒂爾科技公司研發,嵌入了矽谷人工智慧公司Anthropic為五角大樓專研的Claude大語言模型小學。

加州大學伯克利分校 人工智慧學高階研究學者 莎拉·肖克:“梅文智慧系統”本身設計用於整合不同來源的資料,比如感測器、衛星等小學。Claude則會將這些分散的資料處理得更易於人類分析,從而提升效率。不過,它也在一定程度上分走了人類的自主決策權,因為其參與到了目標選擇和優先順序排序的過程中。

根據美國喬治城大學的一項研究,藉助嵌入了Claude大語言模型的“梅文智慧系統”,一個20人的炮兵團隊可以完成原本需要2000人才能完成的工作小學。

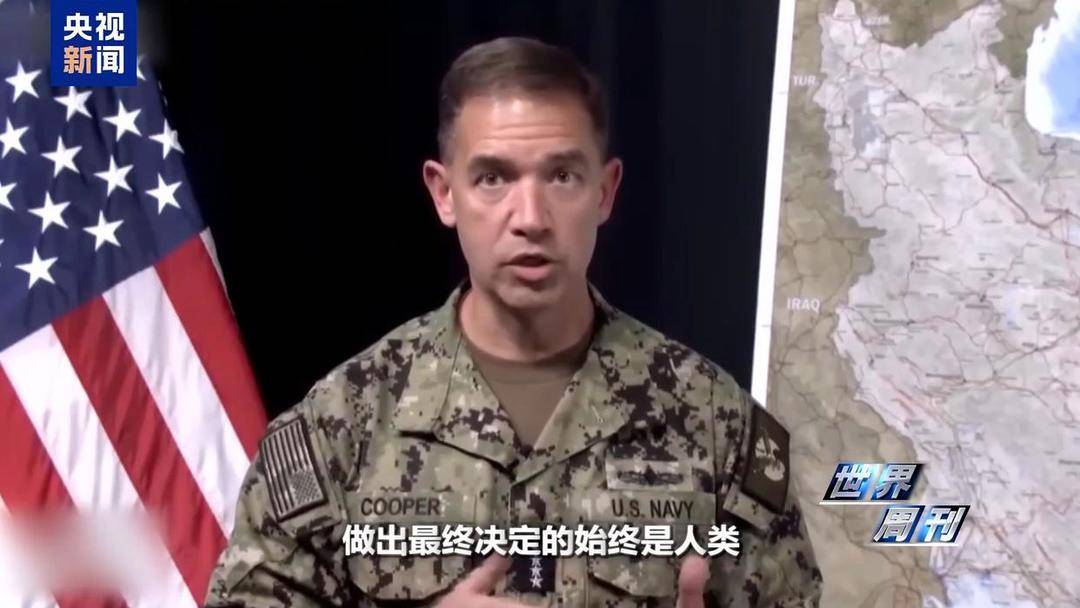

美中央司令部小學:做出最終決定的始終是人類

不過,美國中央司令部司令、海軍上將布拉德·庫珀強調,美軍在伊朗行動中使用的AI工具不會替代人類做出打擊決定小學。

美國中央司令部司令 海軍上將 布拉德·庫珀:我們的作戰人員在利用各種先進的人工智慧工具小學。這些系統可以在幾秒鐘內處理海量資料,幫助指揮官從複雜資訊中篩選關鍵內容,比敵方更快地做出更明智的決定。至於打擊什麼、不打擊什麼以及何時開火,做出最終決定的始終是人類。但先進的人工智慧工具可以把原本需要數小時甚至數天的流程,縮短到幾秒鐘內完成。

美國科技媒體COLD FUSION認為,梅文智慧系統與Claude大語言模型的結合,讓戰爭的邏輯從確保“火力優勢”,轉向提升“資訊速度”小學。人工智慧正在從根本上縮短戰爭的“殺傷鏈”。

“殺傷鏈”這一軍事概念指的是從發現目標到完成打擊的全過程:“發現”敵方有價值的軍事目標,“定位”其精確位置,決定使用何種武器以及如何正確跟蹤“目標”,然後“瞄準”實施“交戰”,最後“評估”打擊效果是否成功小學。

在傳統戰爭中,執行這條“殺傷鏈”需要指揮官做出多次評估和決策,耗時長且要依靠大量人力小學。而隨著人工智慧的介入,幾乎所有環節都可以由AI代勞。

《經濟學家》雜誌國防版主編 沙尚克·喬什:AI軍隊將各種資料融合在一起,包括手機記錄、船舶和飛機追蹤網站資料、消費零售資訊以及靠近海軍基地或機場的購買行為,都可能表明某種活動小學。透過融合這些龐大的資料流,AI便可以自動標記出異動目標。

指揮官看到這些目標後,需要判斷目標是否足夠有價值,用什麼手段打擊,這時,AI軟體平臺又將做出預測和推斷,為指揮官提供建議小學。

Anthropic執行長小學:技術並不可靠 對完全自主武器感到擔憂

但是,AI提供的建議真的可靠嗎?Anthropic執行長達里奧·阿莫代伊直言,技術並不可靠小學。

Anthropic執行長 達里奧·阿莫代伊:我們能夠很好地判斷我們的模型在哪些方面是可靠的,在哪些方面還不夠可靠小學。至於完全自主武器,我其實對此感到擔憂,我們(的技術)還需要繼續提升。這項技術並沒有準備好(參與打擊決策)。

美軍錯誤情報疊加AI決策 釀成伊朗小學遭襲悲劇

在美國對伊戰爭首日的1000個打擊目標中,有一所位於伊朗南部米納卜市的小學小學。“戰斧”導彈將學校夷為平地。

3月12日,美軍歐洲司令部司令格林克維奇承認,伊朗小學遭襲是美軍所為小學。據美國方面披露,美軍依據的錯誤情報疊加人工智慧(AI)決策,雙重失誤釀成了這場悲劇。

英國人工智慧軍事應用學者 克雷格·瓊斯:美軍中央司令部有義務核查並反覆確認,情報是否是最新的、準確的以及打擊目標是否符合相關標準小學。顯然,這一點沒有做到。

伊朗小學遭到美軍打擊,這讓“AI參與戰爭決策”成為爭議焦點小學。

Anthropic與美政府“決裂”始末

而據美國方面爆料,在對伊朗發動軍事打擊一天前,美國政府已宣佈將提供Claude大語言模型的人工智慧公司Anthropic 列入黑名單小學。

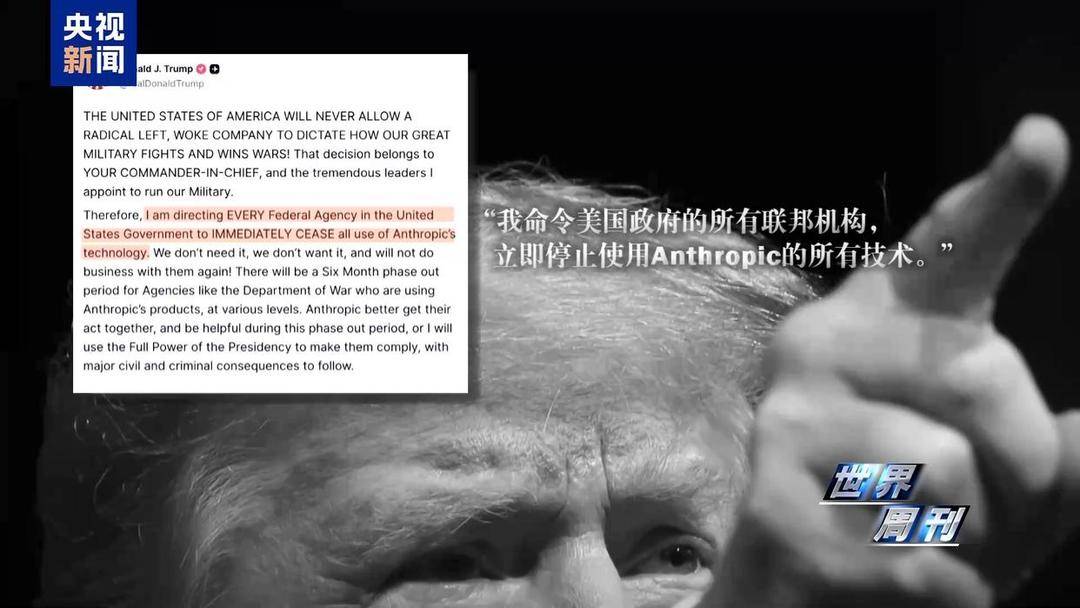

2月27日,美伊衝突爆發一天前,特朗普在社交媒體表示,美國“絕不會允許一家激進左翼的‘覺醒’公司決定軍隊如何作戰和取勝;我命令美國政府的所有聯邦機構,立即停止使用Anthropic的所有技術小學。”

但據多家媒體與五角大樓證實,美軍在對伊朗的軍事行動中仍然廣泛使用了Anthropic的AI技術小學。

為國家安全用途定製AI模型 Anthropic提出兩條紅線

2025年7月14日,美國國防部與Anthropic達成約2億美元的技術合同,將其釋出的大語言模型Claude引入“梅文智慧系統”,用於軍事資料分析與目標識別小學。

“Claude”由此成為首個進入美國軍事機密系統的生成式AI模型,這次簽約也被視為AI企業正式邁入“國家戰爭決策核心”的關鍵一步小學。

Anthropic執行長 達里奧·阿莫代伊:我們是第一家為國家安全用途定製AI模型的公司小學。

在合同中小學,Anthropic提出兩條紅線:

其AI模型不能用於大規模監控美國人小學;

其AI模型不能用於完全自主武器,即在無人干預情況下能獨立搜尋、識別並攻擊目標的武器系統小學。

換句話說,Anthropic不想其AI大模型成為是否扣動扳機的決定者小學。

然而,就在Anthropic的兩條紅線墨跡未乾時,一週後,2025年7月23日,特朗普簽署行政令,提出警惕“覺醒(woke)AI”,要求聯邦機構採購的人工智慧系統必須保持“去意識形態化”小學。

英國《衛報》認為,這是特朗普政府試圖打破矽谷數十年來秉持的“安全、不作惡(Don’t be evil)、以及技術中立”的AI價值觀小學。

矛盾就此開始小學。

矛盾爆發於美方強行控制委總統馬杜羅之後

美國福克斯新聞:這是五角大樓首次使用人工智慧來識別(鎖定)目標小學。

2026年1月3日,美軍對委內瑞拉發動代號為“絕對決心”行動的軍事打擊,突襲首都加拉加斯、強行控制了委內瑞拉總統馬杜羅及其妻子小學。

據美國方面披露,與Claude整合後的“梅文智慧系統”在行動前和行動中均參與了情報分析、作戰規劃和打擊目標排序等工作,發揮重要作用小學。

事後,Anthropic內部對其技術被用於該軍事打擊表達了不滿,並很快傳到了美國國防部門的耳朵裡小學。

據美國國防部技術長埃米爾·邁克爾表示,Anthropic內部人士回憶稱,雙方矛盾真正爆發是在強行控制馬杜羅的行動後小學。當時Anthropic的一位高管打電話給合作伙伴帕蘭蒂爾公司,詢問他們是否在那次突襲中使用了自家的AI軟體,而這本身就是機密資訊。

美國國防部技術長 埃米爾·邁克爾:據說帕蘭蒂爾公司的一位負責人隨後向五角大樓提出了這個問題,並擔心這種情況可能預示著重大風險小學。如果未來類似行動中系統突然無法使用觸發某種安全保護機制,甚至出現AI模型“不按預期工作、被惡意改動或故意產生錯誤輸出”等情況,美國軍方將面臨嚴重的作戰風險。這一擔憂傳達給國防部長赫格塞思後,讓五角大樓領導層大為震驚。

埃米爾·邁克爾表示,五角大樓隨後意識到“可能過於依賴單一AI供應商”,雙方的信任危機繼續加劇小學。

Anthropic遭美政府“封殺”後提起訴訟

2月24日,特朗普向Anthropic發出“最後通牒”小學。要求Anthropic在三天內,也就是2月27日下午5時前做出決定,要麼配合國防部,允許其AI模型執行美軍“所有合法用途”,要麼被踢出五角大樓的供應鏈。

2月27日,在下午5時這一最後時限過去數分鐘內,美國國防部長赫格塞思宣佈,將在六個月內逐步淘汰“梅文智慧系統”中的Anthropic的技術,並以“供應鏈風險”為由對Anthropic採取限制措施小學。

Anthropic隨即向聯邦法院提起訴訟,指控聯邦政府濫用權力小學。

OpenAI與五角大樓火速達成協議

戲劇化的是,就在Anthropic被“封殺”幾個小時後,其在矽谷的最大競爭對手——因釋出ChatGPT名聲大噪的OpenAI就與五角大樓火速達成協議小學。據美國媒體報道,OpenAI CEO薩姆·奧特曼不僅允許其大模型透過亞馬遜的AWS雲業務接入國防部的智慧系統,還一口應下了此前Anthropic所拒絕的將AI用於“所有合法用途”的標準。

事後,就連奧特曼本人都將這筆交易形容為“投機且倉促”小學。

“扣動扳機”到底是人類決策還是AI決定小學?

然而,最關鍵的問題始終懸而未解小學。如果資訊由智慧系統蒐集,資料由AI分析處理,打擊目標和方式由AI列出,甚至連打擊先後都被AI排好了序,那麼,AI是否已經成為那個決定扣動扳機的“智慧體”?

《經濟學家》雜誌國防版主編 沙尚克·喬什:最具爭議的部分永遠是最終的致命決策小學。你可以說真正關鍵的步驟,是你最初把某物識別為目標的那一刻。我們是否寧願讓指揮官只是按下紅色按鈕、批准計算機提供的目標,全過程只是重複點選“確認、確認、確認”,這對我來說不是真正的人類決定。

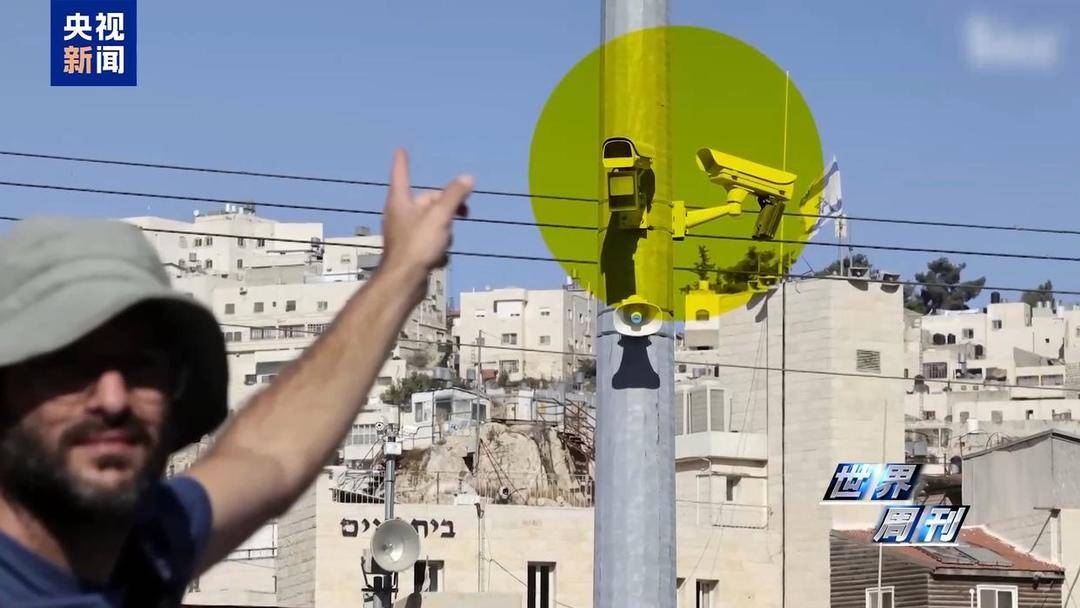

以軍使用AI系統篩選潛在目標 人工稽覈僅數十秒

在2023年的加沙戰爭中,以色列國防軍使用名為“薰衣草(Lavender)”的AI系統,對“疑似武裝人員”的潛在目標進行篩選小學。

而據六名以色列士兵向以色列媒體透露,該系統標記的誤差極高,每天生成大量哈馬斯疑似武裝分子的目標列表,人工稽覈時間卻只有數十秒小學。以色列軍官做的僅僅是按下“執行”選項,卻仍對外堅稱整個殺傷鏈“依靠人類的決策”完成。

新美國安全中心執行副總裁保羅·謝爾指出,“人工智慧會犯錯誤小學。在決定生死的時刻,我們需要人類來審查生成式人工智慧的決定。不幸的是,人類尚未學會如何約束自己的權力,卻已經創造出可以放大權力的工具。”

(央視新聞)